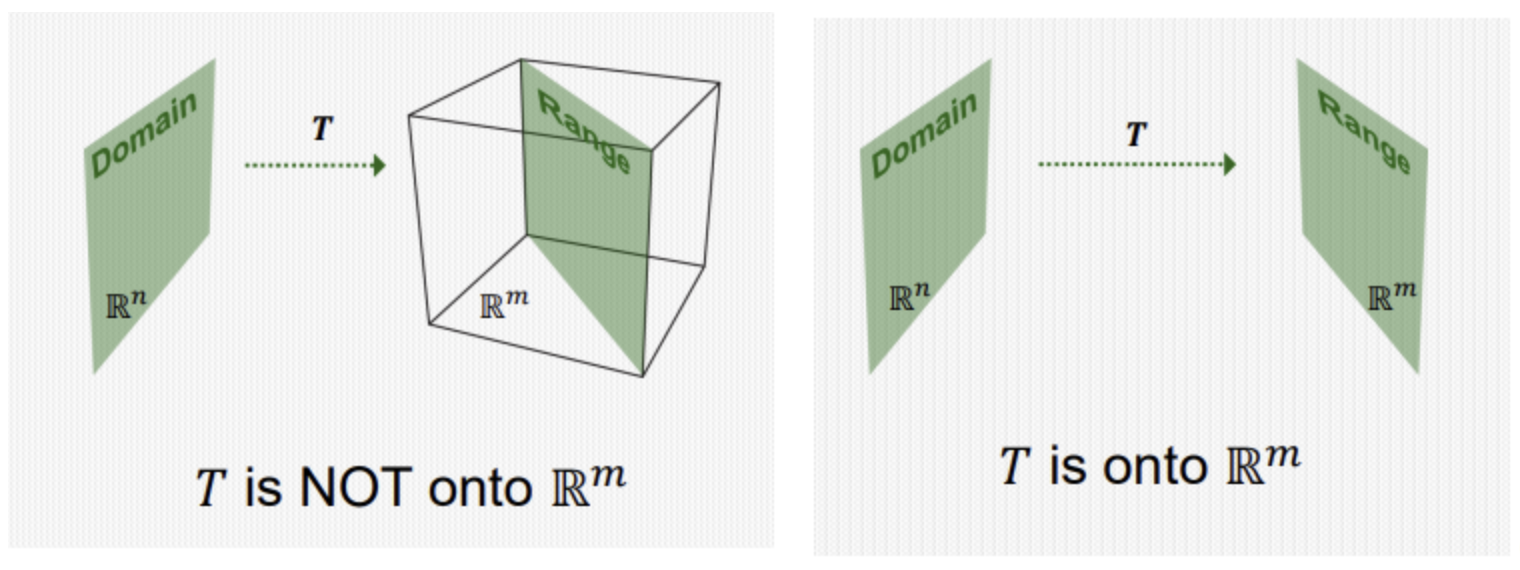

1. 전사함수 (ONTO Mapping): 매핑 T:R^n→R^m에서 모든 b∈R^m이 적어도 하나의 x∈R^n에 대한 이미지(b=T(x))일 때즉 , 전사 함수는 공역(Codomain)의 모든 원소가 적어도 하나의 치역(Range)에 대응되는 경우를 말한다 핵심 특징: 치역(Range)과 공역(Codomain)이 일치해야 합니다.Onto가 아닌 경우: 치역이 공역(Rm)의 일부 공간(예: 3차원 내의 평면)에만 머무를 때.Onto인 경우: 치역이 공역 전체를 꽉 채울 때. -> 공역이 모두 치역에 대응해야함 -> 정의역 개수> 공역의 개수 2. 일대일 함수 (One-to-one Mapping): 매핑 T:R^n→R^m에서 각 b∈Rm이 최대 하나의 x∈R^n에 대한 이미지일 때, 이를 One-to-..