오늘은 선형변환에 대해서 배워봤습니다.

1. Transformation (변환)

: 입력 x → 출력 y로 바꾸는 함수

: 표기: T:x→y

- Domain: 가능한 입력 값들

- Codomain: 가능한 출력 값들

- Image: 특정 x에 대한 출력

- Range: 실제 출력 값들의 집합

특정 x-> 의 출력값은 함

수값은 1개다

2. 선형변환(Linear Transformation)

: 형태를 유지하는 변환이다.

선형변환 예시

3. Transformation between Vectors(벡터 변환)

: n차원 백터를 m차원 벡터로 바꾸는 것

첨에는 왜 차원이 바뀌지 생각했는데 어떤 규칙에 따라서 바꿈(인공지능에서 차원축소와 확장 가능)

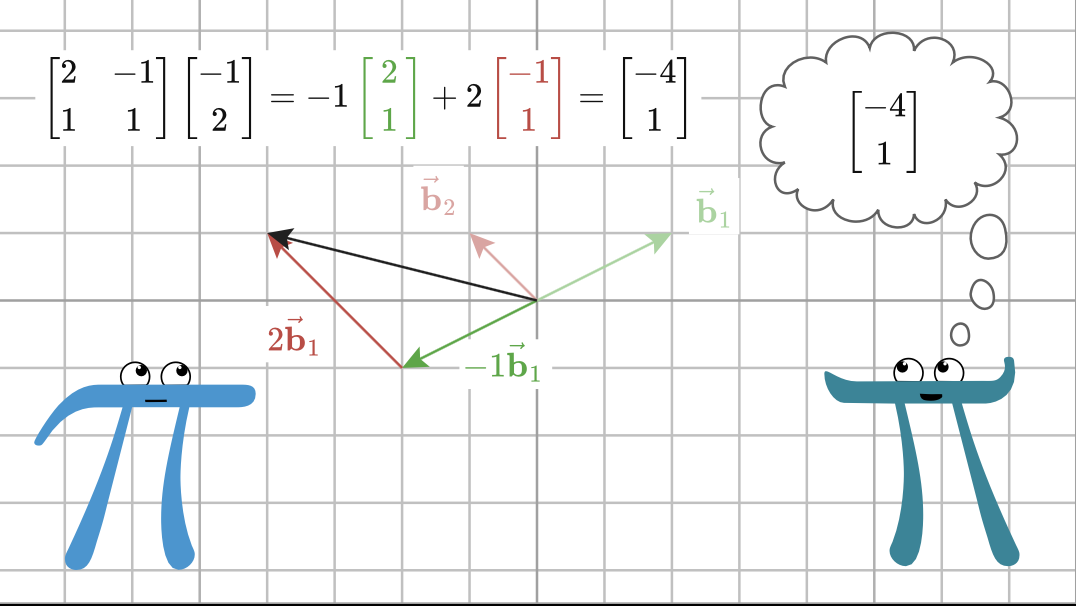

4. Matrix of Linear Transformation(선형변환행렬)

: 선형변환한 후 T(x) = Ax 형태로 나타낼 수 있음

: 모든 선형변환은 행렬로 표현 가능

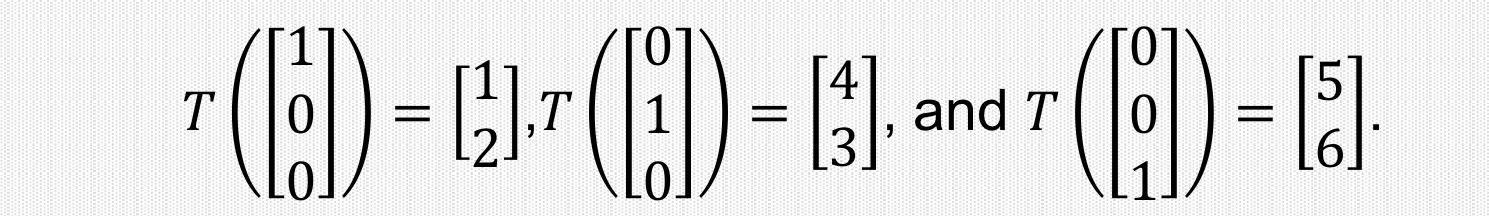

표준행렬(standard matrix)

: A=[T(e1),T(e2),...,T(en)]

: 위에서 변환시킨 벡터를 열방향으로 붙이기

예) 3차원-> 2차원 변경행렬이 이렇게 제공됐을 때

5. Linear Transformation in Neural Networks(신경망에서 선형변환)

- Fully-connected layer = 선형변환

깊은 신경망은 선형변환의 연속이라고 볼 수 있다

그림에서처럼

- 입력

- 신경망

- 출력

=> 신경망은 선형변환(행렬 곱) 계속 반복한다

6. Affine Layer (아핀계층 실제 AI)

: 실제 AI 신경망에서 사용되며 식은 y=Wx+b

- W: 변형, 가중치 (Weight)

- b: 이동, 편향 (bias)

예시

* bisa 가 있어야 더 유연해져서 밑에 1 같은 bias가있음, 다양한 패턴 표현 가능

'선형대수' 카테고리의 다른 글

| [선형대수] 2-7. 전사함수와 일대일함수 (0) | 2026.03.30 |

|---|---|

| [선형대수] 2-5. 부분공간의 기저와 차원 (0) | 2026.03.23 |

| [선형대수] 2-4. 선형시스템 및 선형변환 (0) | 2026.03.23 |

| [선형대수] 2-3. 선형결합(Linear Combinations) (0) | 2026.03.23 |

| [선형대수] 2-2. 실습 (0) | 2026.03.23 |